如果未來,AI機器人普及,每個人都可以按照自己的理想型去定義伴侶,你會想要嗎?如果你發現有另一個“自己”正在被他人操控,你要如何“奪回”自己的命運?再或許,未來的世界中,人們要遵循機器的邏輯、服從于算法的規則,你會接受嗎……

一直以來,人們對AI的想象從未停止。近日,上面這些奇葩的情景就出現在了B站上一位來自清華大學的視頻博主“在下小蘇”制作的一期視頻里。她讓我們看到人工智能技術在改變社會各個方面的同時,也正在通過一件件社會爭議事件提醒我們:那些看似不著邊際的想象,也許將來就會發生在我們身邊。而AI倫理問題也成為當下社會必須面對并思考的問題。

值得慶幸的是,很多人已經開始關注到這些問題,并試圖找到答案,小蘇就是其中的一位。為此,她專程拜訪了在人工智能企業——曠視科技工作的師兄,就「AI發展過程中,技術進步和倫理問題哪個更應該優先考慮」這一話題展開了深度對話,引發了平臺年輕用戶的熱烈討論。

AI發展的AB面

技術本質是中立的,但技術應用在不同場景的效果卻不盡相同,AI也是如此。視頻中,小蘇特別分享了自己關注的AI倫理事件,再一次表明技術在帶來紅利的同時,也可能對社會帶來意想不到的后果。

身份盜用的風險。

Deepfake技術曾被炒得沸沸揚揚,網絡的負面評論遠多于其帶來的技術魅力,眾多惡搞作品、利益欺詐等消息,讓人們對Deepfake技術頗有微詞。但其實,這個現象的背后是身份被盜用的風險在增大;而如何保護人們的身份權益,往往考驗的是人們在技術應用、法律法規、行業標準等各方面的綜合智慧。

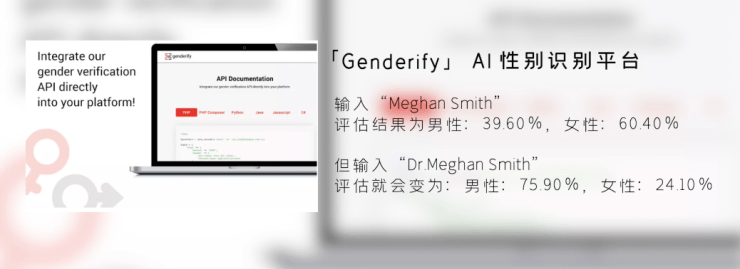

算法歧視的隱憂。

人類的命運是否會被算法所左右?算法是否公平?視頻中提到的一款名為Genderify的AI性別識別平臺,用戶在該平臺上直接輸入姓名或者個人電子郵件地址,即可獲取性別判斷的結果。但同樣的姓名,如果加入前綴“Dr.”,測試出的結果往往是男性,這就引發了“性別歧視”的爭議。類似這種有意的或無意的引發對不同性別、種族、文化、弱勢群體等產生差異化判斷的算法,我們應當如何對待呢?

人機關系的迷茫。

人類和機器人談戀愛,這是科幻影片題材的最愛。可如果現實中真的有技術可以讓機器再現人類的情感,你是會接受還是要拒絕呢?這樣的應用已經開始出現,而對此的探討一直都引人關注。

很多人在初涉這個領域時會把“AI倫理”和“AI治理”混為一談,其實它們之間更像是“病癥”與“治療”的關系。“AI倫理”產生出的問題,需要“AI治理”通過體系化的方式進行處理和解決。當然,人們對“AI倫理”標準的討論和認知是動態發展的,這就決定了“AI治理”也是一個基于協調多個利益相關方的、持續互動的過程。

所以,若想深入了解這一領域,首先要從認識“AI倫理”問題、培養相關意識開始。

視頻中也介紹到,目前國內以中國社科院、清華大學、復旦大學、上海交大等為代表的高校、科研機構都已經開展了AI倫理的相關研究,外界可以及時關注研究進展。此外,世界人工智能大會、北京智源大會等行業頂級峰會都設置了相關分論壇,討論AI倫理問題,呼吁更多人關注AI行業的可持續發展。

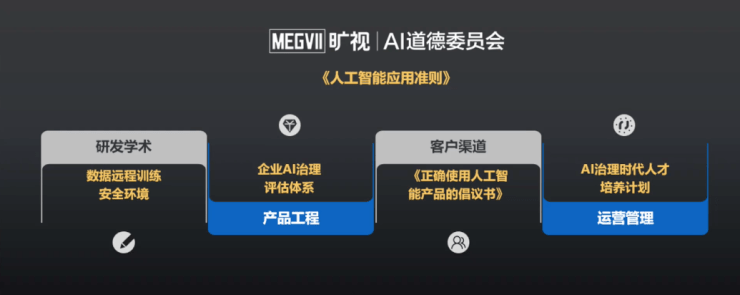

其次,要了解“AI治理”的各種方式和參與各方的進展。

現在社會各界,包括產、學、研、政、企等各個相關方,都在積極行動探索“AI治理”的方向和方法。以企業的AI治理為例,曠視也進行了一系列務實推進,從基本原則的建立,到對內組織機構建設、對外開展聯合研究,曠視一直在行動。

對于個人而言,最關鍵是找到合適的學習資源和渠道。

AI倫理問題其實是門綜合學問。對于年輕人來說,想要更好的理解,需要帶著實際問題去思考;高校或者行業大會也是獲取前沿觀點的重要渠道。當然,還可以到AI企業實習,親身實踐。

當下,AI技術的正向發展需要AI治理作為基礎保障,無論是剛剛開始從事技術研發的“AI新一代”,還是從業多年的行業老兵,亦或只是AI產品的用戶,都有必要認識到AI倫理的重要性。此次小蘇通過視頻,帶領大家初步了解了AI倫理與治理的相關知識;未來,“AI第一課”還將繼續關注AI領域發生的事件,帶來更有價值的討論,持續推動人工智能朝著可持續的方向發展。